Our AI Technology

AB AIが提供する技術のご紹介

ARMアーキテクチャは、高効率と省電力を両立し、モバイルからサーバーまでの幅広いデバイスに革命をもたらしています。

当社は日本市場にARMアーキテクチャに基づくAIクラウドコンピューティングサービスおよびクラウドストレージソリューションの提供を開始しています。

ARMアーキテクチャ: 次世代の核心技術

ARMアーキテクチャは、高効率と省電力を両立し、モバイルからサーバーまでの幅広いデバイスに革命をもたらしています

当社は日本市場にARMアーキテクチャに基づくAIクラウドコンピューティングサービスおよびクラウドストレージソリューションの提供を開始しています。

エネルギー効率:

ARMアーキテクチャのサーバーは、エネルギー効率の面で優れたパフォーマンスを発揮します。ARMチップの設計は、消費電力制御とエネルギー効率の最適化に重点を置いており、従来のx86アーキテクチャと比較して、同じ消費電力でより高い計算性能を提供します。それにより、ARMサーバーは大規模なAI計算においてより高いパフォーマンスを発揮し、エネルギー消費と運営コストの削減に寄与します。

スケーラビリティ:

ARMアーキテクチャのサーバーは、優れたスケーラビリティを持っています。ARMチップの設計により、サーバーは柔軟に計算リソースを拡張することができ、異なるスケールと複雑さのAI計算を満たすために、マルチノードやクラスターを構築することができます。この柔軟性のあるスケーラビリティにより、ARMサーバーは並行のAI計算に対応し、より優れたパフォーマンスと柔軟性を備えています。

低遅延性:

ARMアーキテクチャのサーバーは、AI計算において低遅延性を実現することができます。ARMチップのアーキテクチャ特性と最適化設計により、データの処理と応答がより速く行われ、推論プロセスの遅延が低減されます。それは、リアルタイム性と迅速な意思決定が必要な自動運転やスマートセキュリティなどのアプリケーションにおいて非常に重要です。

上記の特徴により、ARMアーキテクチャはAI計算においてますます多くの企業や研究機関の選択肢となり、効率的で信頼性の高い革新的なソリューションを提供できます。

それらの技術能力により、当社は人工知能分野の将来展開においてアドバンテージを確立しています。

当社は、スペースの節約、電力の削減、そして計算能力の向上を実現するそのようなサーバーが非常に大きな市場を持つと考えており、そして当社はその提供を開始しています。

Introduction of our technology and products

【当社技術と製品のご紹介】

AIトレーニングとAI推論

人工知能(AI)の分野では、AIトレーニングとAI推論は2つの重要な要素です。AIトレーニングは、大量のデータと強力な計算能力を用いて、機械学習アルゴリズムによってモデルをトレーニングし、パターン認識、規則学習、予測能力を備えさせることを指します。一方、AI推論はトレーニング済みのモデルを実際のシナリオに適用し、リアルタイムのデータ処理と意思決定を行ないます。AIトレーニングとAI推論は密接に連携し、相互に促進し合い、完全な人工知能アプリケーションを構成します。2023年、人工知能の急速な発展により、多くの大企業がそれぞれの大規模モデルの開発に取り組んでいます。その後、さまざまな業界の垂直モデルは、大部分のトレーニングが完了し一定の精度レベルに達した後、AI推論の需要がますます重要になります。

現在、人工知能の爆発的な成長期にあり、人工知能の中でも特に重要な大規模言語モデル(LLM)は、AIトレーニングにNVIDIAの高性能GPUチップが必要なだけでなく、AI推論計算には効率の高いCPUアーキテクチャも必要です。当社のARM技術アーキテクチャを採用したサーバーは、LLMのAI推論計算に最適であると考えています。当社は、9月初めにシンガポールのKaytus社と提携し、NVIDIAチップの販売とサービスを提供していますが、それはLLMのAIトレーニング向けです。一方、当社が提供するのサーバーは、AI推論計算の潜在的な用途において、LLMの運用に対するハードウェアソリューションを提供します。

潜在的な技術パートナーに当社の製品とサービスをより詳しく知っていただくため、また投資家に当社の潜在能力をより明確にするために、以下に当社が提供する技術の簡潔な紹介をします。

(1) AIクラウド計算+AI+AI推理アプリケーション

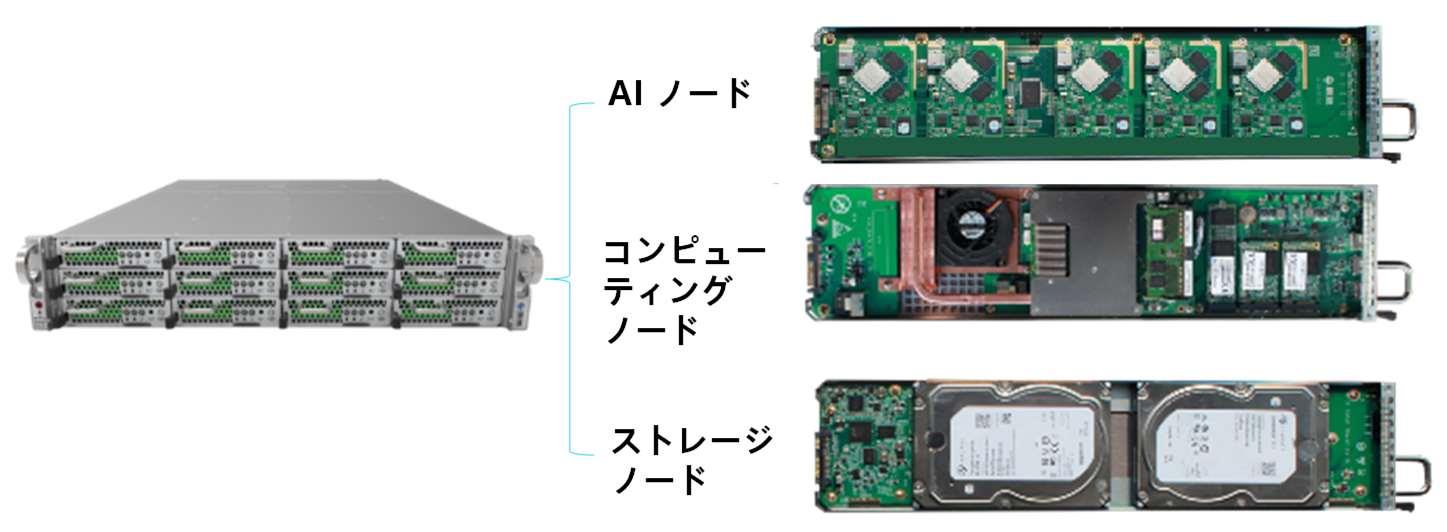

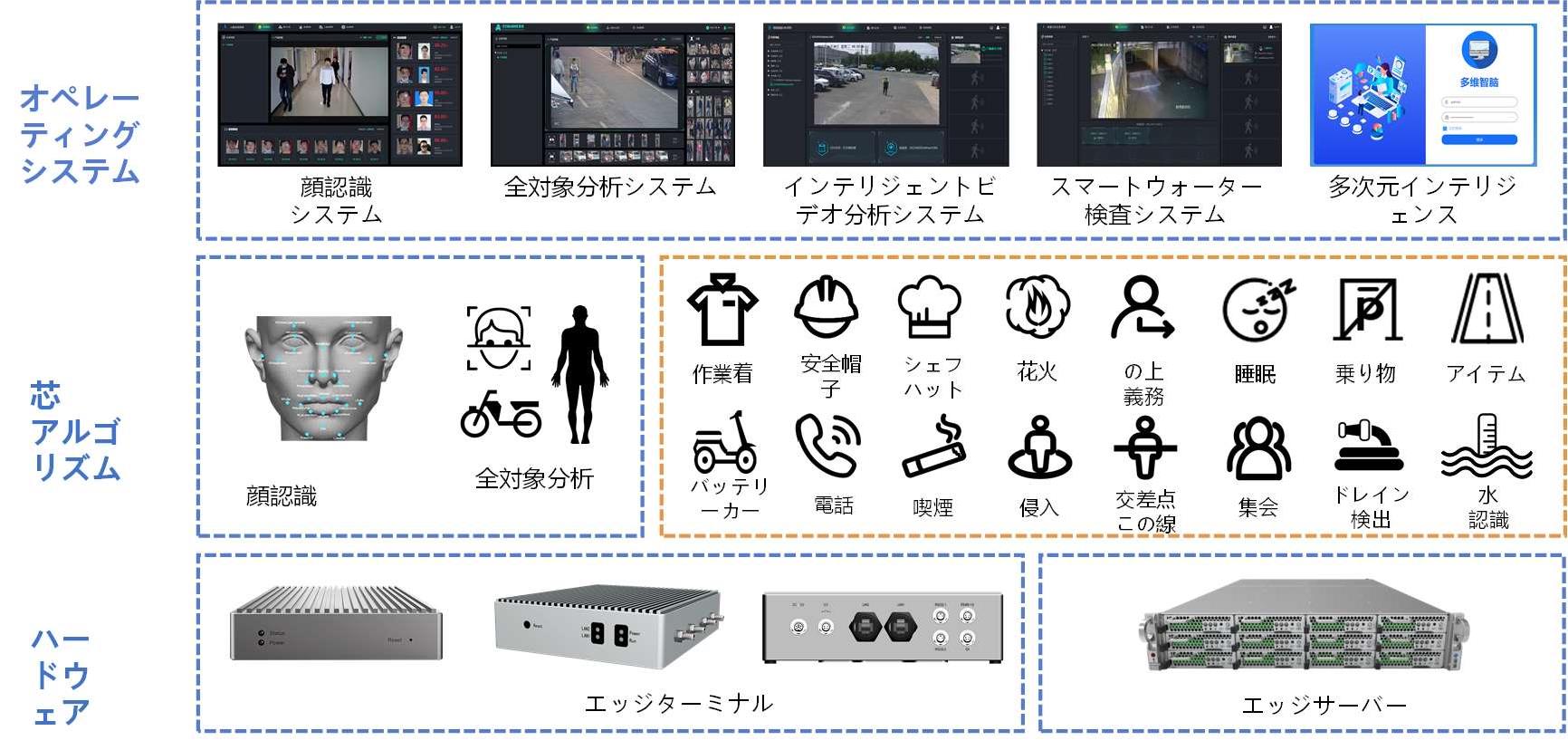

ARMアーキテクチャをベースとしたソリューションを提供することにより、コンピューティングノード、AIノード、ストレージノードなどを含む、低遅延のクラウドコンピューティングを実現し、5Gの発展に対応します。それにより、現地のデジタル戦略や産業4. 0の発展に応えることができます。当社のソリューションは、企業や公共機関のクラウドコンピューティングにおける計算能力とストレージの需要を満たすだけでなく、関連するインフラやホスティングサービスの需要、およびモバイルコンピューティングの需要にも対応することができます。具体的なソリューションには、基本的なハードウェア、コアAIアルゴリズム、およびさまざまなシナリオでのアプリケーションが含まれます。

ARMアーキテクチャをベースとしたソリューションを提供することにより、コンピューティングノード、AIノード、ストレージノードなどを含む、低遅延のクラウドコンピューティングを実現し、5Gの発展に対応します。それにより、現地のデジタル戦略や産業4. 0の発展に応えることができます。当社のソリューションは、企業や公共機関のクラウドコンピューティングにおける計算能力とストレージの需要を満たすだけでなく、関連するインフラやホスティングサービスの需要、およびモバイルコンピューティングの需要にも対応することができます。具体的なソリューションには、基本的なハードウェア、コアAIアルゴリズム、およびさまざまなシナリオでのアプリケーションが含まれます。 自社開発のAI推論アルゴリズムの応用シナリオでは、以下の機能を含むAI機能を実現していますが、それに限りません。

自社開発のAI推論アルゴリズムの応用シナリオでは、以下の機能を含むAI機能を実現していますが、それに限りません。

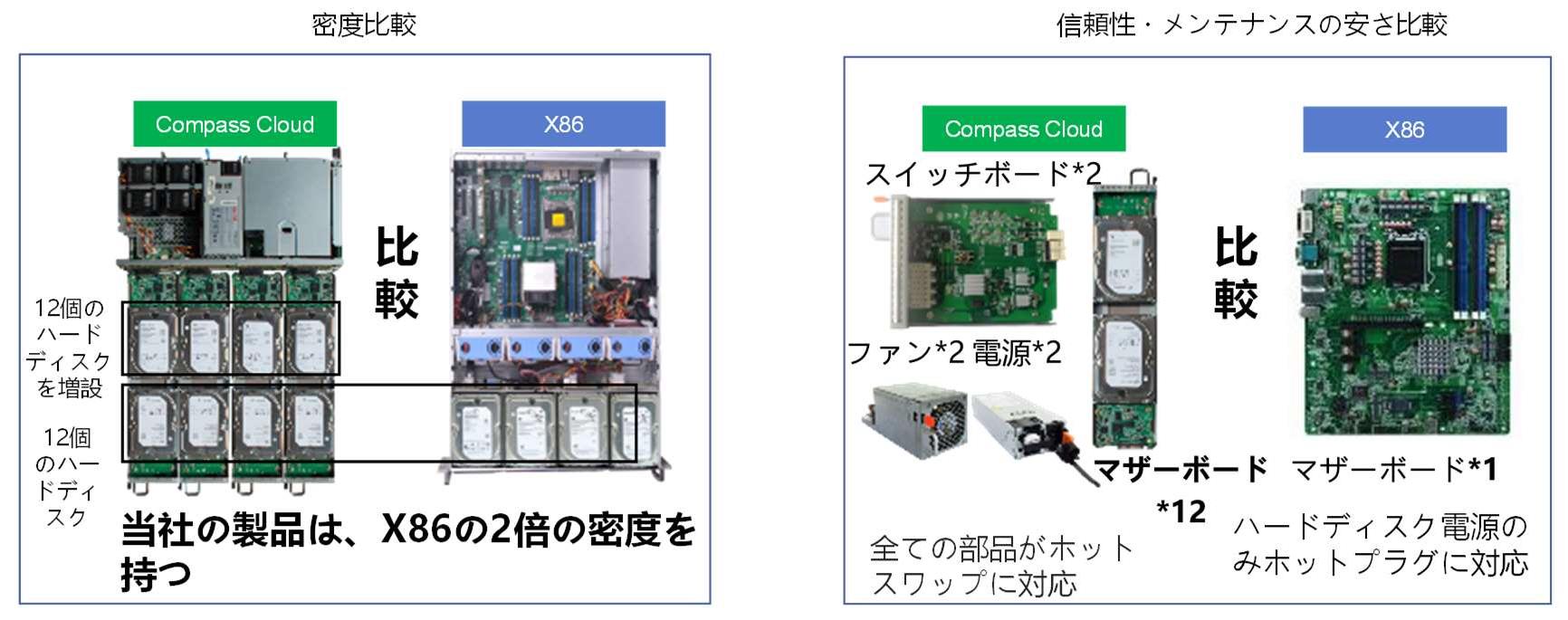

(2) ARMアーキテクチャベースの高密度ストレージ

ARMアーキテクチャに基づいて設計された高密度ストレージ製品は、単位体積と消費電力の点からストレージ容量を大幅に向上させています。

ARMアーキテクチャに基づいて設計された高密度ストレージ製品は、単位体積と消費電力の点からストレージ容量を大幅に向上させています。

(3) ARMアーキテクチャに基づくセキュリティ携帯電話

「安全携帯電話」は、個人専用のプライベートクラウド携帯電話ボックスで、あらゆる種類のファイルをクラウド上に置くことができます。写真、ビデオ、アプリ、連絡先、音声、ドキュメントなどのデータをプライバシー保護し、ユーザーにより多様な外部デバイスのアプリケーション体験を提供します。セキュリティ携帯電話の機能は以下の通りです。1) セキュリティ携帯電話へのアクセス

アプリケーションのデスクトップロゴは任意のソフトウェアの入口にすることができ、特別なパスワードを使用してのみリモートで「セキュリティ携帯電話」にアクセスできるようになっています。それにより、他人がこの携帯電話に侵入することができず、データの絶対的な安全性を保証します。2) データのゼロ占有と安心なストレージ

すべてのデータが「セキュリティ携帯電話」に保存されるため、通常の携帯電話は「セキュリティ携帯電話」へのアクセスポイントにすぎません。そのため、「セキュリティ携帯電話」に保存されたすべてのコンテンツは通常の携帯電話のメモリを一切使用しません。 ARMアーキテクチャに基づいて設計された高密度ストレージ製品は、単位体積と消費電力の点からストレージ容量を大幅に向上させています。

ARMアーキテクチャに基づいて設計された高密度ストレージ製品は、単位体積と消費電力の点からストレージ容量を大幅に向上させています。3) ウイルスなどの侵入の防止

セキュリティ携帯電話は、信頼できるダイナミックなセキュリティ設計に基づいており、不正プログラムの実行を防止します。4) ワンクリックでデータを完全に削除

セキュリティ携帯電話には、使用したすべてのデータを一括削除する独自の機能が搭載されており、エンドツーエンドの二重保護を提供します。5) 二重認証、二重暗号化

セキュリティ携帯電話は、ゼロトラストのセキュリティフレームワークに基づいています。それは、次世代のネットワークセキュリティの考え方です。データの転送と保存の暗号化、ネットワークアクセスのセキュリティ、デバイスデータのセキュリティを提供します。

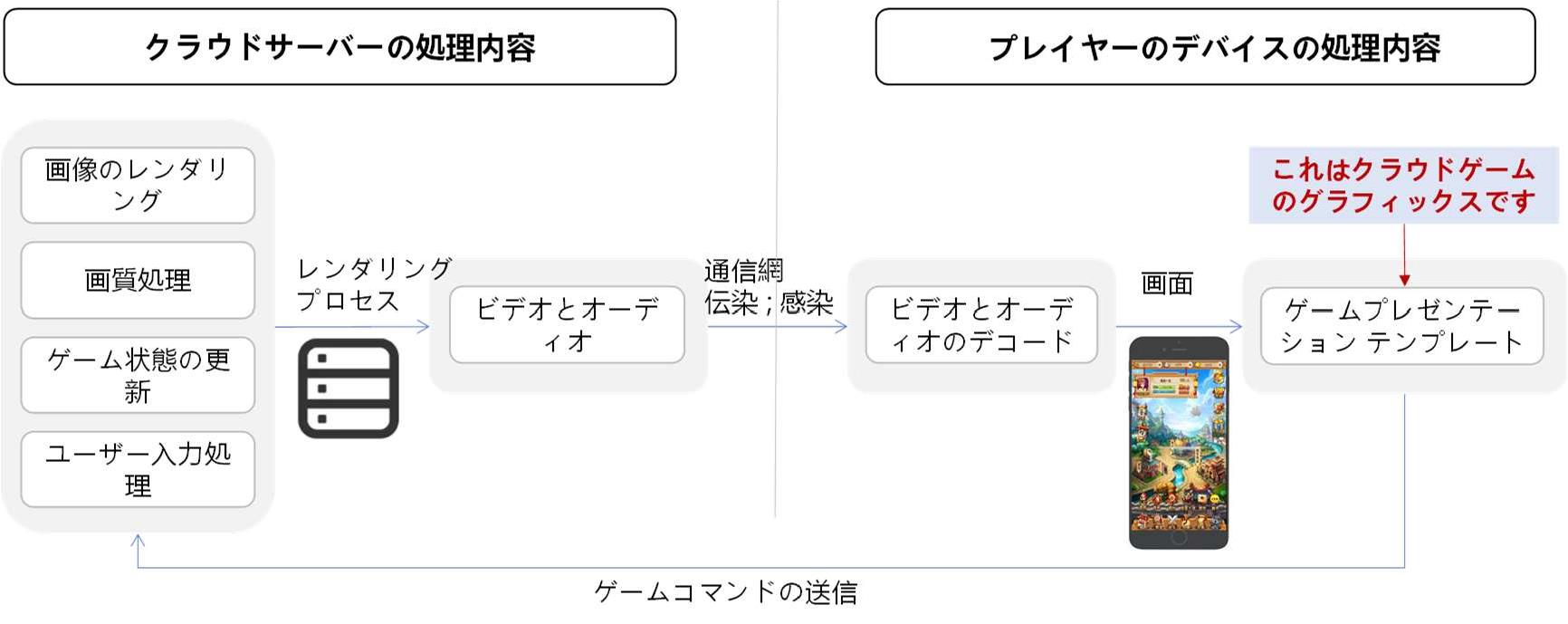

(4) ARMアーキテクチャのクラウドゲーム業界向けソリューション

クラウドゲームの場合、ゲームはプレイヤーのデバイスではなく、クラウドサーバー上で実行され、クラウドサーバーがゲームシーンをビデオおよびオーディオストリームにして、プレイヤーのゲーム端末にネットワーク経由で転送します。 ゲーム開発者は、当社のクラウド化技術を使用して完全なアプリパッケージを処理し、HTML5ゲームリンクを生成します。プレイヤーはゲームをダウンロードする必要なく、リンクをクリックするだけでウェブページでゲームをプレイできます。

ゲーム開発者は、当社のクラウド化技術を使用して完全なアプリパッケージを処理し、HTML5ゲームリンクを生成します。プレイヤーはゲームをダウンロードする必要なく、リンクをクリックするだけでウェブページでゲームをプレイできます。クラウドゲーム技術は、日本のゲーム業界に効率の向上をもたらし、従来は超大型パッケージをダウンロードしてゲームに参加する必要があったすべてのユーザーが、ウェブゲームの体験に戻ることができます。

1、 クリックしてすぐにプレイ可能な最もシンプルなユーザーエクスペリエンスの提供

RM技術を使用することで、豊富なアプリゲームを、従来のウェブゲームのようなクリックしてすぐにプレイ可能な形式に変換できます。プレイヤーはクライアントをダウンロードする必要なく、より多様なコンテンツを楽しむことができます。2、 クラウドゲームコミュニティの構築

新しいクラウドゲームコミュニティを構築し、ゲームユーザーを集約し、ユーザーが自分に最適なゲームコンテンツをより便利に見つけることができるようにします。クラウドゲームコミュニティは、運営者がプラットフォームの配信権を取り戻すことができるようにします。